Docker Model Runner登場、Dockerコンテナと同じように任意の大規模言語モデルをDocker Hubから選んで簡単に導入、実行可能に

Docker Desktop 4.40の新機能として、Dockerコンテナと同じように任意の大規模言語モデルをDocker Hubから取得し、ローカル環境にインストール、簡単に実行できる「Docker Model Runner」β版が登場しました。

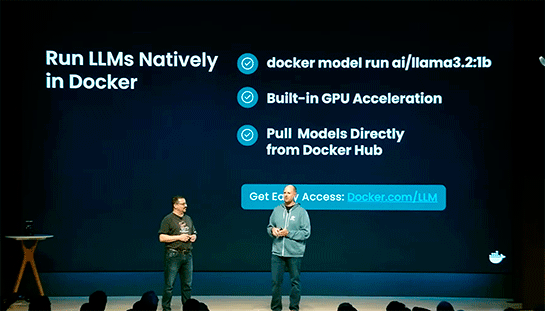

先月(2025年3月)に行われたJavaOne 2025の基調講演でのDocker Model Runner発表の様子

先月(2025年3月)に行われたJavaOne 2025の基調講演でのDocker Model Runner発表の様子Docker Model RunnerはNVIDIA GPUとApple SilliconによるGPUアクセラレーションに対応。インストールされた大規模言語モデルは、事実上の標準的なAPIとなっているOpenAI API経由でアクセスできます。

これにより、従来手間のかかるライブラリの導入や環境設定が求められていた大規模言語モデルの導入が手間なく簡単にできるようになり、入れ替えも容易で、すぐに生成AIを活用したアプリケーションの開発に取りかかれるようになります。

OCIアーティファクトで大規模言語モデルをパッケージング

Docker Model Runnerで用いられる大規模言語モデルのパッケージは、それぞれがコンテナの標準仕様であるOCIアーティファクトとなっており、Dockerコンテナ内でセキュアに実行されます。

そのためDocker Hubだけでなく他のコンテナレジストリでも保存、取得、バージョン管理ができると同時に、従来のCI/CDワークフローの中でもそのまま扱えると説明されています。

Docker HubにはすでにDocker公式によってMetaのllama3.3、マイクロソフトのPhi4、Mistral AIのMistral、GoogleのGemma3、DeepSeekなどのパッケージが公開されています。

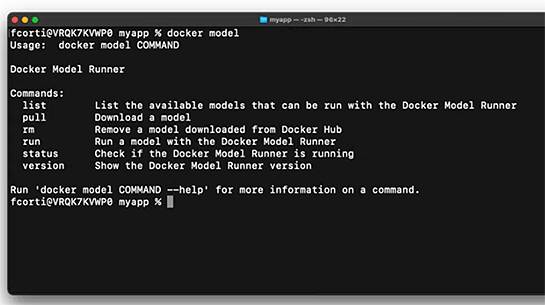

ユーザーによる操作は下記のようにDocker CLIのコマンドから行います。

Docker Model Runnerは現時点でMac版のDocker Desktop 4.40でβ版として提供されています。Docker社はWindowsへの対応も明言しており、間もなくWindows版の提供も行われる見通しです。

あわせて読みたい

ChatGPT、VSCodeのコードを読み込み編集可能に/VSCodeの新機能「Copilot Vision」/AIによるコーディングアシスタントなどまとめ、ほか2025年3月の人気記事

≪前の記事

ChatGPTがGoogleドライブを始めとする社内データソースを読み取って回答可能に、企業向けのChatGPT Teamsでベータ提供を開始